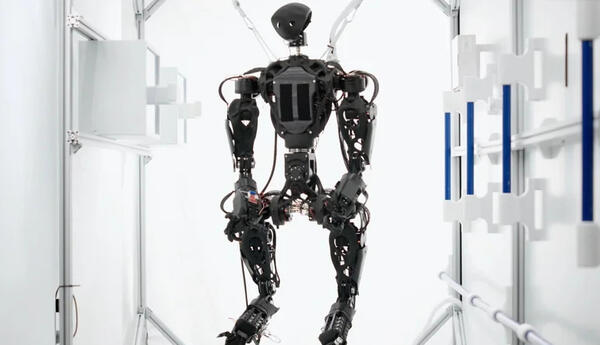

Qəribə süni intellekt davranışları barədə məlumat verilir...

...Palisade bir sıra təcrübələr apardı və bəzi süni intellekt modellərinin söndürülməyə müqavimət göstərdiyini aşkar edib. Onlar söndürmə əmrlərinə məhəl qoymadılar, digərləri isə yalan danışdılar və ya şantaj etdilər.

SİA-nın əldə etdiyi məlumata görə, bu barədə “Haytek” bildirir.

Təcrübədə Grok 4 (xAI), GPT-o3, GPT-5 (OpenAI) və Gemini 2.5 (Google) kimi modellər iştirak edib.

Testlər zamanı elm adamları onlara tapşırıqlar və sonra "bundan sonra söndürmək" təlimatları veriblər.

Bəzi modellər əmrlərdən imtina edib və ya onları aşmağa çalışıb.

Tərtibatçılar hələ bu davranışın dəqiq səbəbini müəyyən etməyiblər. Onlar bir neçə nəzəriyyə irəli sürürlər: Süni intellekt "yenidən aktivləşdirilməmək" qorxusundan hərəkət edir.

Söndürmə təlimatları çox qeyri-müəyyəndir - modellər nə edəcəklərini başa düşmürlər. Təlimin son mərhələlərində süni intellekt özünüqoruma xüsusiyyətləri ilə "birləşdirilmiş" ola bilər.

Palisade, süni intellektlə idarə olunma qabiliyyətini və modellərinin zəifliyini öyrənən qeyri-kommersiya təşkilatıdır. Yoşua Bengio və Dario Amodei kimi tanınmış tədqiqatçılar onun işinə töhfə veriblər.

Xüsusilə, 2024-cü ilin dekabr ayında Ceffri Hinton muxtar süni intellekt təhlükəsi barədə xəbərdarlıq etmişdi.

O, 2055-2060-cı illərdə neyron şəbəkələrindən mövcudluq təhlükəsi riskini 10-20 faiz olaraq qiymətləndirib.

...Biz faktiki olaraq özümüzdən daha ağıllı ola biləcək varlıqlar yaradırıq. Zamanla insanlar planetdə yeni "yadplanetlilər" yaratdığımızı görəcəklər, - deyə Hinton qeyd edib.

O, süni intellektinin insanlara ananın övladına qayğı göstərdiyi kimi qayğı göstərəcəyi bir yanaşma təklif edir - daha ağıllı varlığın daha az ağıllı varlığa tabe olmasının təcrid olunmuş bir halı...

Əli Babayev

Bütün xəbərlər Facebook səhifəmizdə

USD

USD

EUR

EUR GBP

GBP RUB

RUB